人工智能 + 演出 = 沉浸式体验 2.0:当舞台能感受观众的情绪

🎬 引言

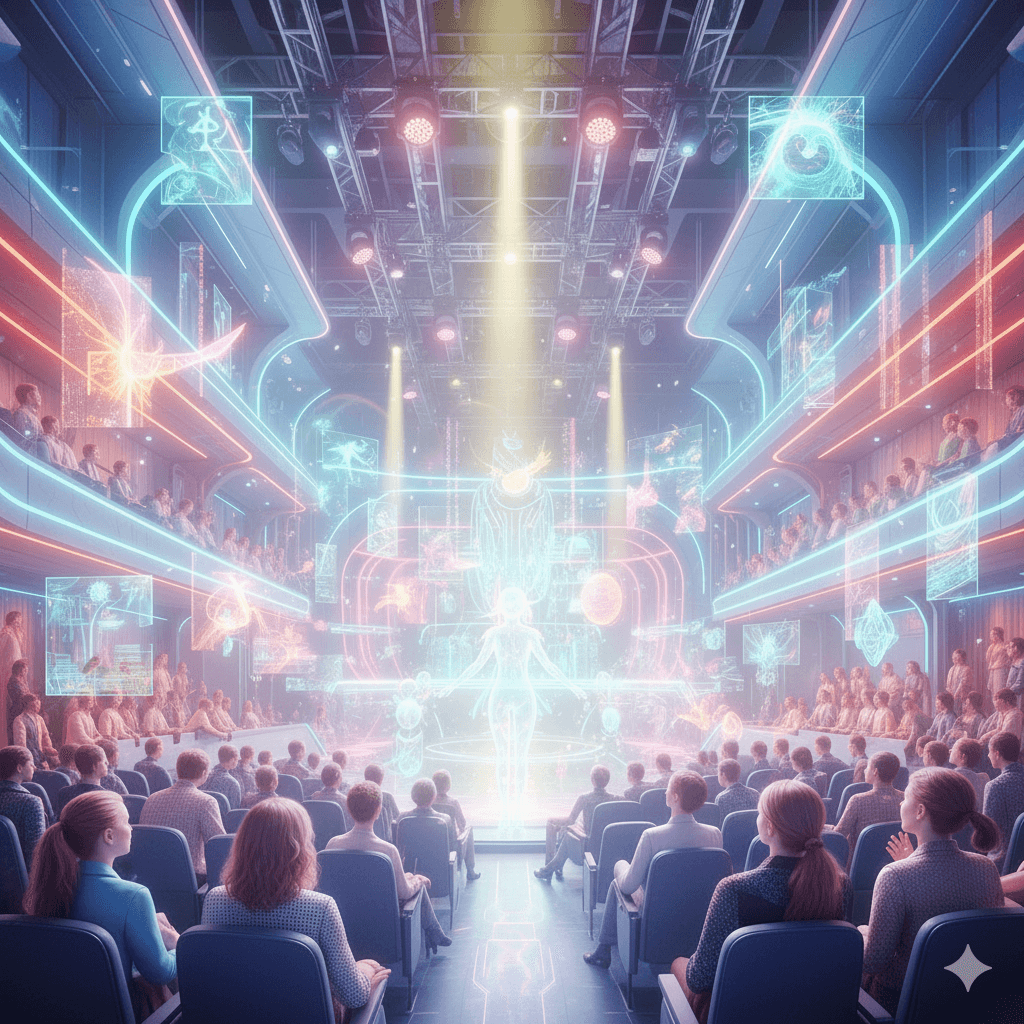

想象一下:你坐在剧院中。灯光、音乐、投影交织成梦幻的场景。

突然,灯光因为你的微笑而改变。

一个全息影像转过身,直视着你。

这不是魔术——而是人工智能的力量。

💡 “演出不再只是表演——它能感受你。”

欢迎来到 沉浸式 2.0 (Immersion 2.0) 的时代,科技开始读懂观众的情绪,并即时做出反应。

📖 目录

🌀 “沉浸式 2.0” 是什么?

过去的“沉浸式体验”,意味着光影、声音、3D 效果。

如今,它是AI 交互体验:演出会根据观众的情绪、面部表情、甚至语音语调进行变化。

Immersive 2.0 象征着从被动观看到情感互动的跃迁。

舞台变成了一个能感受观众能量的“活体系统”。

💬 AI 如何学会“感受”观众

现代 AI 系统能实时分析观众的反应:

|

技术 |

功能 |

示例 |

|

Emotion Recognition AI |

识别微表情与情绪变化 |

Affectiva、EmotionNet |

|

Voice Sentiment Analysis |

通过语音判断开心、惊讶或无聊等情绪 |

DeepVoice |

|

Motion Capture + LIDAR |

捕捉肢体动作与姿势 |

Muse、LIDAR 传感器 |

|

Reactive Algorithms |

实时改变灯光、声音或视觉效果 |

Runway ML、Unreal Engine AI |

🧩 示例:

- 当观众笑时,舞台“绽放”出明亮的色彩。

- 当观众安静下来,音乐变得极简与柔和。

🌍 全球代表性项目:AI 如何感受情绪

|

项目 |

城市 |

特点 |

|

The Wizard of Oz at Sphere |

🇺🇸 美国拉斯维加斯 |

AI 根据观众情绪调整视觉和灯光 |

|

Silent Echo |

🇬🇧 英国伦敦 |

剧情根据观众呼吸与心率变化 |

|

Deep Symphony |

🇰🇷 韩国首尔 |

AI 作曲家根据观众整体情绪调整交响乐 |

|

MetaOpera |

🇩🇪 德国柏林 |

摄像头追踪观众视线,角色根据观众注视方向回应 |

|

Sphere 360° |

🇷🇺 俄罗斯莫斯科 |

无人机与灯光根据掌声与噪音强度反应 |

🔗 来源:

⚙️ 幕后技术揭秘:传感器、摄像头与神经网络

驱动“会思考的演出”的核心技术包括:

- 🎥 情绪识别摄像头 — EmotionNet、Affectiva

- 🎤 语音情感传感器 — DeepVoice

- 🧠 生物感应设备 — Muse、Empatica

- ⚡ 生成式视觉系统 — Runway、Unreal Engine AI 工具

- 🔄 实时算法平台 — OpenAI Realtime API

🧠 三大并行流程:

- 捕捉观众反应

- 分析情绪数据

- 即时反馈 —— 改变灯光、声音或故事节奏

🎭 情绪就是剧本:未来趋势

AI 剧作已经开始登场。

未来的演出将根据观众的集体情绪实时重塑情节。

🎡 未来方向:

- 智能剧院:声学与灯光根据观众能量自动调节

- 个性化场景:每位观众看到略有不同的版本

- 情感 VR 音乐会:视觉内容随呼吸节奏而变化

🎙️ “伟大的艺术家懂得感受观众,如今 AI 也能做到。”

—— 改编自康斯坦丁·斯坦尼斯拉夫斯基名言

💡 观众与艺术家的新体验

优点:

- 每一场演出都独一无二

- 更深层的情感参与

- 创意表达的新形式

缺点:

- 隐私风险:AI 分析面部与情绪数据

- 情绪过载可能带来疲劳

- 技术可能掩盖艺术本身

🧠 信息图:AI 如何“读懂”观众

摄像头 🎥 → 情绪 😊 → 分析 🤖 → 反应 💡 → 效果 🌈

展示了从观众情绪到舞台反应的实时链路。

🎬 结语

娱乐世界不再静止。

人工智能让舞台成为人类情感的镜像。

我们不再只是观众,而是故事的一部分。

🌐 在 AIMarketWave.com 探索更多关于人工智能与未来创意的文章。